Porno tvořené umělou inteligencí ohrožuje ženy. Odráží to nejhorší z nás

Falešné pornografické video s vaší tváří, vytvořené na základě několika desítek fotografií z internetu? Díky pokroku v oblasti umělé inteligence jsou nástroje, které to dokážou, dostupné většině lidí. Doplatí na to zejména ženy. Aplikace navíc už nyní reprodukují jejich sexualizované obrázky. "Je to zrcadlo, které odráží to nejhorší z nás," říká výzkumník deepfakes Matyáš Boháček.

Žena s tváří herečky Emmy Watson se laškovně usmívá a vzápětí si kleká ke kolenům muže, který ji natáčí. "Nainstaluj jakýkoliv obličej do videa," zněl popisek reklamy na aplikaci FaceMega, která se začátkem března objevila v AppStoru, Google Play i na sociálních sítích Facebook a Instagram společnosti Meta. Upozornila na to americká televize NBC, která zjistila, že aplikace zveřejnila podobné reklamy také s tváří herečky Scarlett Johansson. Až po uveřejnění reportáže tuto aplikaci oba online obchody i Meta stáhly. Podobné nástroje však v obou obchodech zůstávají, upozornil server Insider.

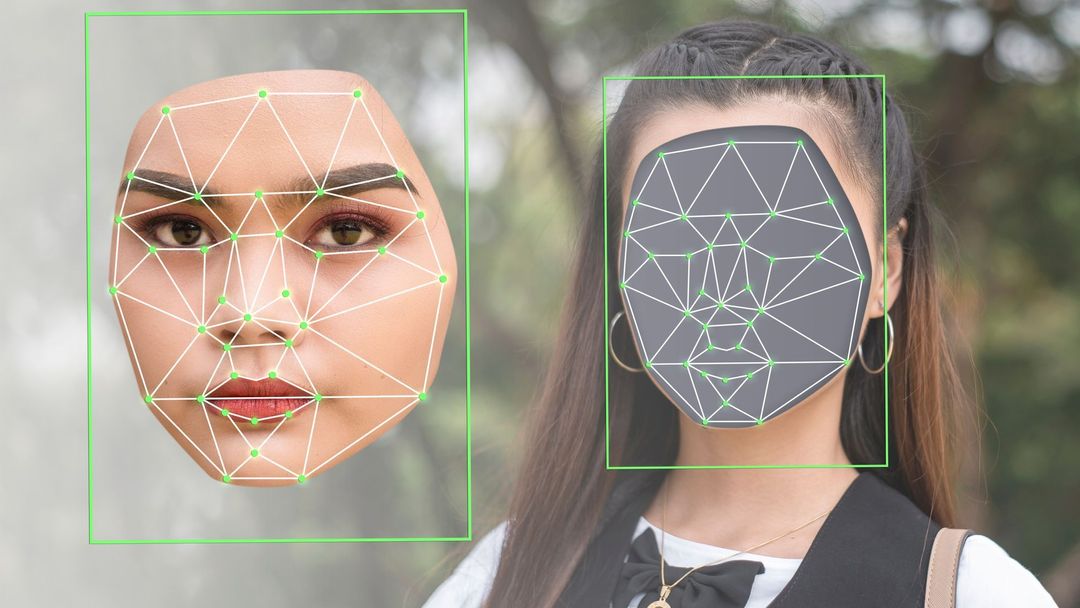

FaceMega i podobné aplikace fungují na principu deepfake, což jsou falešná videa nebo fotografie, které jsou však velmi realistické. Obvykle se jedná o umístění něčí hlavy na cizí tělo. Tato technologie existovala již dříve, ale díky zdokonalení a zpřístupnění umělé inteligence se v poslední době stává čím dál rozšířenější.

Dříve byly potřeba tisíce fotek, dnes stačí desítky

Matyáš Boháček, který pracuje na výzkumu o deepfakes, vysvětluje, že za současným boomem falešných videí stojí zejména přístup k většímu množství dat modelů strojového učení, jejich větší výpočetní síla a to, že jsou nyní "zabalené" do uživatelsky příjemného webového rozhraní. "Aplikace na změnu tváří proto mohou používat lidé, kteří neví a ani nepotřebují vědět, jak to funguje. Vytvářejí si zábavná videa, ale mohou toho i zneužít," upozorňuje. Podle dostupných studií je v současnosti 90 až 95 procent deepfake obsahu na internetu pornografického charakteru.

To je hrozbou zejména pro ženy, které se již dříve stávaly oběťmi takzvaného porna z pomsty, kdy jejich známí, často bývalí partneři, umísťují jejich nahé fotografie na internet. Pornografie tvořená umělou inteligencí je pro ženy dalším rizikem. Advokát Michael Farhi sdělil americkému Insideru, že explicitní obsah tvořený umělou inteligencí se velmi pravděpodobně stane zbraní používanou proti ženám po celém světě.

Boháček jeho slova potvrzuje. "Drtivou většinou obětí pornografických deepfakes jsou ženy," říká s tím, že vytvořit opravdu věrohodné video stále ještě vyžaduje určitou míru dovedností. Jednoduché záměny obličeje sice už nyní zvládne díky pokročilým nástrojům každý, ale na výsledku je to stále poznat. Tvorba falešných videí je však čím dál tím jednodušší a časem bude pravděpodobně možné je tvořit doma "na koleni".

"Dřív k tomu navíc bylo potřeba mnohem více trénovacích dat, takže kdybych chtěl udělat něčí deepfake, potřeboval bych stovky nebo tisíce jeho fotek v různých kontextech, ve dne, v noci, v interiéru a v exteriéru. Potřeboval bych také spoustu informací o tom, na koho bych jej pasoval. Dnes by mi stačilo třeba 10 až 20 fotek a mohl bych udělat dost přesvědčivé video," vysvětluje Boháček zásadní posun s tím, že potřebná data jsou dnes v modelech již obsažená. Takové množství fotografií má přitom mnoho aktivních uživatelů sociálních sítí na svých veřejných profilech.

Kam až umělá inteligence v tomto zajde a jak realistické budou generované obrazy? Podle filozofky a odbornice na strojové učení Dity Malečkové si o tom lidstvo rozhodne samo, ne však na základě klasické celospolečenské diskuse. "Nyní probíhá vzájemný dialog mezi člověkem a strojem. Každá malá interakce, každý člověk, který vytváří obrázek, je pro umělou inteligenci informací o tom, co chceme," říká s tím, že vývojářským firmám jde koneckonců o profit a chtějí vytvářet nástroje, které budou lidé používat.

Pokuty pro sociální sítě jako východisko

Boháček vysvětluje, že původní záměr deepfake byl čistě pozitivní a tato videa měla obohatit zejména herní průmysl. Před zhruba dvaceti lety, kdy tato technologie vznikala, však bylo v online prostoru oproti dnešku velmi málo dezinformací, a tak výzkumníci přehlíželi tento potenciál. Kromě her se dají deepfakes využít při natáčení filmů. "Mimo to je ale seznam pozitivního využití velmi malý. Jde například o anonymizaci svědků v soudních řízeních. V porovnání s množstvím škodlivých dopadů je to ale zanedbatelné," říká.

Jakmile se falešné pornografické video dostane na sociální sítě, hrozí, že se začne šířit. S tím má zkušenost i youtuberka vystupující pod jménem QTCinderella, která před několika týdny zjistila, že se stala objetí deepfake pornografie. V pozdějším streamu v slzách promluvila o neustálé objektivizaci žen a dodala, že lidé, kteří nad tím jen mávnou rukou, "si nedokážou představit, jaké to je, vidět se na videu, kde děláte věci, které jste nikdy nedělali, a přihlížet tomu, jak tyto obrázky posílají vaší rodině."

Podařilo se jí dohledat placenou deepfake stránku, odkud se video šířilo. Nejprve podala žádost o jeho stažení, ale když materiál dál koloval, pokusila se platformu zažalovat. Brzy však zjistila, že je současná americká legislativa na falešná videa krátká. "Všichni právníci, které jsem kontaktovala, se shodli na tom, že neexistuje precedens a že nemám šanci je zažalovat," řekla youtuberka, která sdílí zejména obsah o videohrách, televizi NBC.

Boháček přitom upozorňuje, že úprava legislativy je podmínkou pro to, aby se dařilo proti deepfakes bojovat. Existují sice nástroje, které dokážou falešná videa detekovat, sociální sítě je ale nechtějí využívat. "Tyto detektory mají totiž ze své podstaty jistou míru chybovosti, takže určitý počet videí, která jsou reálná, označí za falešná, a naopak," vysvětluje.

Sociální sítě proto argumentují dilematem omezování svobody projevu s tím, že nechtějí filtrovat důvěryhodný obsah. "Detektory proto deepfake pouze vytipují, o jejich stažení nicméně rozhodnou až zaměstnanci, často dávno potom, co se stal virálním," přibližuje odborník. Cestou je podle něj zákonně ukotvit penalizaci platforem, které zvyšují dosah takového druhu pornografie. "Shodují se na tom i odborníci na bezpečnost a forenzní vědy," dodává.

Internetový ideál krásy

Kromě deepfake videí uživatelé generují také pornografické obrázky. Ačkoliv největší aplikace mají většinou řadu omezení včetně zákazu vytváření urážlivého nebo explicitního obsahu, Malečková vysvětluje, že jednak je poměrně snadné tato omezení obejít, a jednak se tím vytváří prostor pro nástroje s menším počtem uživatelů, které tvorbu sexualizovaného obsahu umožňují. "Je o něco těžší takový obsah vygenerovat, ale podle skupin, které sleduju, to lidé zvládají. Vídám zejména obrázky mladých holek s rysy podobnými manga komiksům a obrovskými ňadry, což je takový internetový ideál krásy 21. století," říká.

AI can take your image and do anything with it. Synthetic porn is a booming business. Anyone can create their perfect woman (or shapeshifter, hybrid, you name it). None of the women in this photo are real. But then, what's real anymore? pic.twitter.com/s72X23CTcN

— Karen Hunt aka KH Mezek (@karenalainehunt) February 19, 2023

Boháček její slova potvrzuje. Modely totiž mají tendenci ženy zobrazovat tak, jak jsou statisticky nejčastěji k vidění na internetu - ve stereotypně sexualizovaných situacích. "Učí se stereotypy, které jsou zachycené v online prostoru. V určitém slova smyslu je to zrcadlo, které odráží to nejhorší z nás, ač z toho nechci dělat unáhlené závěry," říká.

Na některé z těchto nešvarů narazili autoři aplikací už během jejich vývoje. "Když trénovali například nástroj Stable Diffusion (aplikace z roku 2022, která převádí text na obrázek, pozn. redakce), měli k dispozici několik stovek milionů obrázků, a vůbec nefiltrovali pornografii nebo ilegální obsah. Když modelu zadali například "žena, která hraje tenis", znázornilo ji to velmi stereotypně v extrémně upnutém oblečení až sexuálního charakteru. Když zadali "žena na pláži", generovalo to někdy ženu nahou. Pokud se to samé udělalo s mužem, nic takového se nestalo," uvádí příklad.

Děje se to ale i u aplikací, které si již lidé mohou stahovat do svých telefonů. Například americký deník Washington Post informoval o tom, že některým ženám, které si nechaly vytvořit autoportrét nástrojem Lensa, aplikace zvětšila poprsí nebo je vyobrazila bez trička. Jedna z uživatelek také Lense nabídla své veřejně dostupné fotografie včetně těch pracovních, a umělá inteligence vygenerovala svou představu toho, jak pravděpodobně vypadá nahá.

Jak se chránit? Čím dál složitěji

Pornografii tvořenou umělou inteligencí lze ve velkém množství případů stále ještě rozeznat, ale neustále se zdokonaluje. Boháček radí zaměřit se na ústa a uši, což jsou části tváře, v nichž technologie nejčastěji chybuje. A jak se proti tomu, aby se člověk ocitl v pornu tvořeném umělou inteligencí, chránit? Podle odborníka čím dál složitěji. "Dřív bych vám poradil, abyste o sobě nezveřejňovali příliš obsahu nebo videí, z nichž by bylo možné modely trénovat. Dnes ale stačí výrazně méně materiálu. Dobré proto je nedávat na sociální sítě fotky, které hraničí s pornografickým materiálem, protože takový obsah je skvělým podkladem pro tvorbu videa. Výrazně velká zábrana to ale není," varuje.

Pokud si lidé budou explicitní obsah vytvářet pro své osobní účely, je to podle něj legitimní, ale stěžejní je zabránit jeho nekontrolovanému šíření na internetu. Budoucnost "umělého" porna je přitom nejistá. Někteří předpovídají, že pornoherce připraví o práci, jiní jsou skeptičtější a věří, že zvítězí touha po skutečných lidech. Malečková se domnívá, že vývoj bude podobný jako u všech trendů. "Nejprve to bude velmi přitažlivé a všichni to budou chtít vyzkoušet, ale pak se začnou zase objevovat tendence, kdy budou lidé vyhledávat punc skutečnosti, který se pozná třeba na nižší kvalitě," míní.

Stejně tak v posledních letech roste poptávka po amatérské pornografii, která stojí v protikladu k vyumělkovaným videím zobrazujícím nerealistickou podobu sexu i lidských těl, která navíc často cílí na heterosexuální muže. Například na databázi Pornhub byla loni celosvětově nejvyhledávanější kategorie "realita" a "domácí" s téměř dvojnásobným nárůstem oproti roku 2021. I kdyby však pornografie vytvářená umělou inteligencí nevytlačila tu "skutečnou", nic to nemění na potenciálních škodlivých účincích deepfakes.